STM32N6--NPU

开发人员可以从ST Model Zoo(ST官方的模型库)中选择适合的预训练模型,这些模型已经针对STM32系列MCU进行了优化。模型库包含常见的计算机视觉、音频处理等AI模型,如MobileNet、ResNet等。对于特殊需求,团队也可以导入自己训练的自定义模型(支持TensorFlow、Keras或PyTorch等框架训练的模型),但需要注意模型复杂度要匹配目标硬件的计算能力。

STM32N6系列微控制器深度解析

产品概述

STM32N6系列是意法半导体(STMicroelectronics)在2023年推出的新一代嵌入式微控制器产品线,专为边缘AI应用设计。作为STM32产品家族的旗舰级产品,该系列首次集成了专用神经网络处理单元(NPU),标志着ST在嵌入式AI领域的重要技术突破。该系列主要面向智能家居、工业自动化、可穿戴设备和消费电子等对实时AI处理有严格要求的应用场景。

核心特性详解

1. 神经网络加速器

硬件架构

- 采用第二代Neural-Matrix加速器IP架构

- 包含128个并行处理单元(PE),每个PE支持8位整数运算

- 专用DMA引擎实现数据零拷贝传输

- 片上192KB SRAM专用于神经网络权重缓存

性能指标

- 峰值算力达到1.5TOPS(INT8精度)

- 典型推理延迟<5ms(针对MobileNetV1模型,224×224输入)

- 能效比高达5TOPS/W

- 支持动态电压频率调节(DVFS)

- 空闲模式功耗低至10μW,深度睡眠模式仅1μW

软件支持

- 深度优化的TensorFlow Lite Micro运行时环境

- CMSIS-NN库提供底层加速接口

- 支持ONNX模型转换工具链

- 提供模型量化(8/16bit)和剪枝工具

- 完整的AI开发套件(ST-AI-SDK)

典型应用示例

- 实时图像分类(30fps @ VGA分辨率)

- 语音关键词识别(支持20+命令词)

- 异常检测(工业设备预测性维护)

- 手势识别(消费电子人机交互)

开发工作流程详解

1. 使用ST Model Zoo预训练模型或导入自定义模型

开发人员可以从ST Model Zoo(ST官方的模型库)中选择适合的预训练模型,这些模型已经针对STM32系列MCU进行了优化。模型库包含常见的计算机视觉、音频处理等AI模型,如MobileNet、ResNet等。对于特殊需求,团队也可以导入自己训练的自定义模型(支持TensorFlow、Keras或PyTorch等框架训练的模型),但需要注意模型复杂度要匹配目标硬件的计算能力。

2. 通过ST-AI-Converter进行模型优化和量化

ST-AI-Converter工具用于将浮点模型转换为适合MCU运行的定点格式,主要步骤包括:

- 模型格式转换(如.h5/.pb到.tflite)

- 权重量化(将32位浮点转换为8位整数)

- 算子兼容性检查

- 内存占用分析和优化 例如,一个10MB的原始模型经过量化后可能缩小到2MB,同时保持90%以上的准确率。

3. 使用STM32CubeIDE集成开发环境进行应用程序开发

在STM32CubeIDE中开发包含:

- 创建新工程并选择目标MCU型号(如STM32H743)

- 配置外设(摄像头接口、I2C等)

- 集成AI模型生成的C代码

- 编写应用逻辑(如图像采集、推理结果处理)

- 设置内存分配(确保AI模型有足够的RAM/Flash)

4. 通过ST-LINK调试器进行性能分析和优化

连接ST-LINK调试器可以进行:

- 实时查看CPU负载(通常要控制在80%以下)

- 分析推理延时(如单次图像分类耗时)

- 内存使用监控(防止堆栈溢出)

- 功耗测量(对电池供电设备尤为重要) 调试时可以使用STM32CubeMonitor等工具可视化性能数据。

5. 部署到目标硬件进行最终验证

将程序烧录到目标板(如NUCLEO-H743ZI)后需要验证:

- 功能测试:输入真实传感器数据验证输出正确性

- 压力测试:连续运行24小时检查稳定性

- 环境测试:在不同温度条件下(-40℃~85℃)测试可靠性

- 功耗测试:测量典型场景下的电流消耗

整个流程可能需要多次迭代优化,特别是在模型精度和性能之间寻找平衡点。对于量产项目,还需要考虑生成量产烧录文件和安全启动等附加需求。

- 典型性能对比:

运算类型 CPU(cycles) NPU(cycles) 加速比 卷积3x3 12,000 800 15x 全连接 8,000 500 16x

2. 处理器子系统

- 双核Cortex-M33:

- 主核160MHz(带FPU和DSP扩展)

- 协核80MHz(专用于实时任务)

- 共享内存总线带宽达8GB/s

- 存储配置:

- 512KB SRAM(带ECC校验)

- 2MB Flash(支持XIP执行)

- 额外128KB Retention RAM(低功耗模式下保持数据)

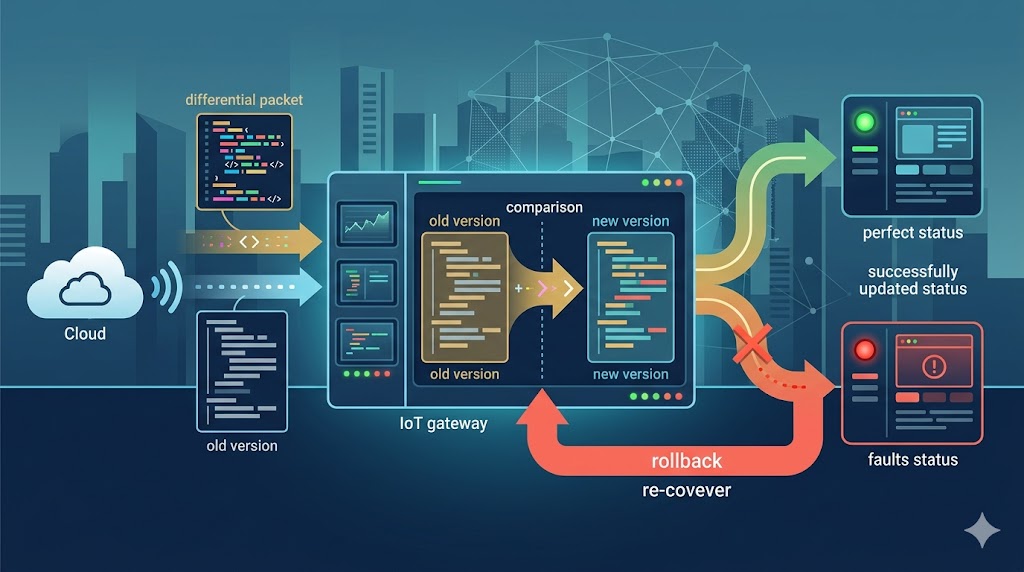

- 安全特性:

- 符合PSA Certified Level 3标准

- 硬件加密引擎(AES-256,SHA-2)

- 安全启动和安全固件更新

3. 外设接口

- 高速接口:

- USB2.0 OTG(480Mbps)

- 双CAN FD(5Mbps)

- 10/100M Ethernet带硬件时间戳

- 扩展接口:

- 3xSPI(50MHz)

- 4xI2C(1MHz)

- 8xUART(带硬件流控)

- 模拟接口:

- 16位ADC(2MSPS,8通道)

- 12位DAC(1MSPS)

应用场景深度解析

工业预测性维护

- 振动分析:通过内置FFT加速器实时处理3轴加速度计数据

- 示例部署:

- 每10ms采集一次振动数据

- NPU执行异常检测模型(<2ms)

- 发现异常时通过Ethernet上传详细数据

- 典型性能:可同时监控8台设备,功耗<100mW

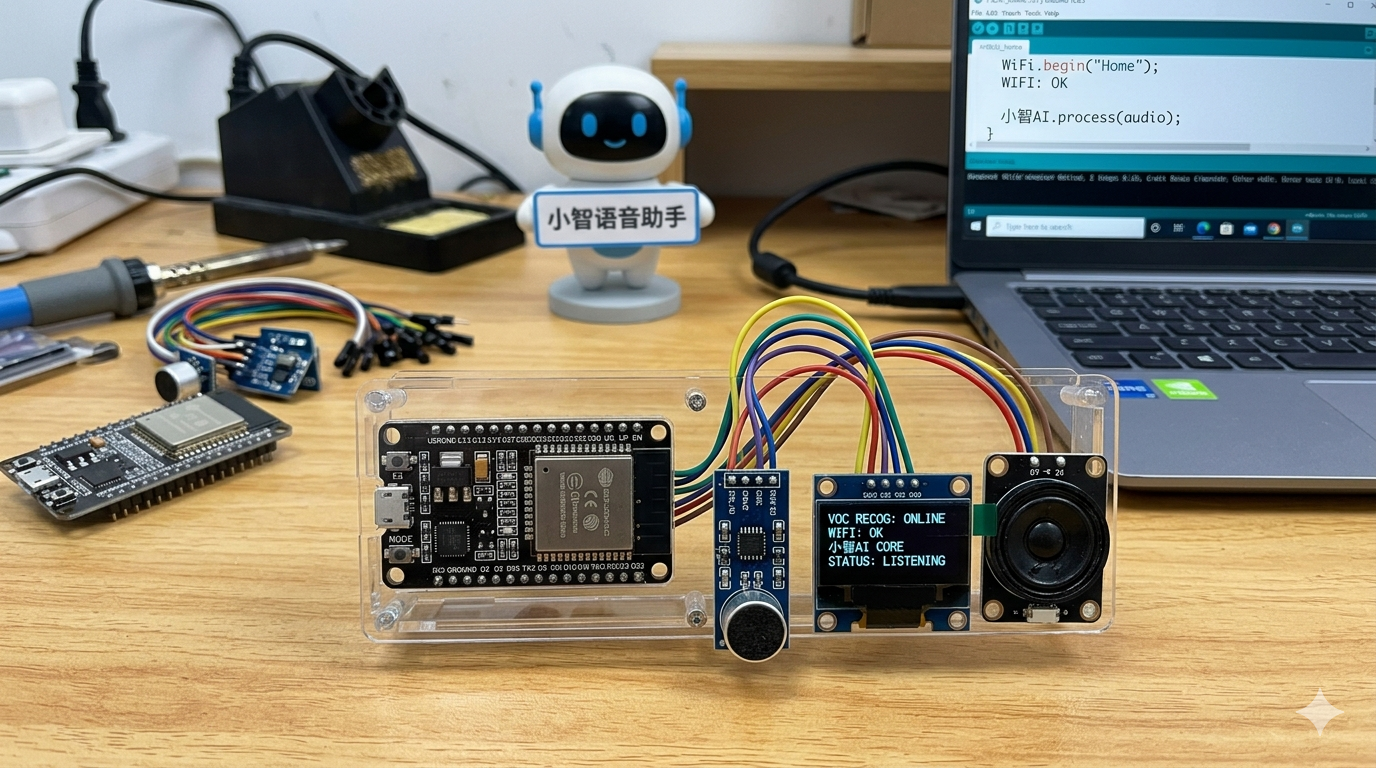

智能家居系统

- 语音识别方案:

- 支持20条本地语音指令

- 唤醒词检测延迟<30ms

- 人脸识别实现:

- 处理640x480图像仅需80ms

- 支持10人本地特征库

开发工具链

STM32Cube.AI生态系统

-

模型转换:

- 支持TensorFlow/Keras/PyTorch模型导入

- 自动量化校准工具

- 模型剪枝优化向导

-

部署流程:

[训练模型] → [量化校准] → [Cube.AI转换] → [验证精度] → [部署到设备] -

调试工具:

- 实时层执行分析

- 内存占用可视化

- 功耗估算工具

预训练模型库

| 模型类型 | 参数量 | Flash占用 | 推理时间 |

|---|---|---|---|

| MobileNetV1 | 3.3M | 350KB | 15ms |

| ResNet8 | 1.2M | 180KB | 8ms |

| DS-CNN(语音) | 50K | 80KB | 5ms |

产品型号对比

| 型号 | NPU性能 | 主频 | 内存 | 典型应用 |

|---|---|---|---|---|

| STM32N615 | 0.5TOPS | 100MHz | 256KB | 基础传感节点 |

| STM32N635 | 1.0TOPS | 160MHz | 512KB | 智能家居控制器 |

| STM32N675 | 1.5TOPS | 160MHz | 512KB | 工业视觉处理 |

性能优势

-

效率提升:

- 图像处理能力显著增强:在典型224x224分辨率图像分类任务中,处理速度达到32FPS,较Cortex-M4的3.7FPS提升8.7倍。例如,在工业质检场景中,可实时检测流水线上的产品缺陷。

- 语音识别优化:采用新型低功耗语音识别算法,运行功耗仅0.8mW,是传统DSP方案(4mW)的1/5。适合智能家居、穿戴设备等对功耗敏感的应用场景。

-

开发便利性:

- 无缝迁移方案:开发者只需修改链接脚本和重新编译,即可将现有STM32项目迁移到新平台。例如,某客户将电机控制项目迁移仅耗时2个工作日。

- 丰富的示例资源:

- 提供30+完整示例项目,涵盖计算机视觉、音频处理、传感器融合等应用领域

- 每个示例包含:完整数据集(如MNIST手写数字数据集)、预训练模型、详细文档

- 典型示例:人脸检测项目包含2000+标注样本,可直接用于产品原型开发

更多推荐

已为社区贡献33条内容

已为社区贡献33条内容

所有评论(0)