Pycharm接入deepseek大模型

ollama (读作欧拉马)是一个轻量级、开源的大语言模型(LLM)运行工具,让你能够在本地设备(如个人电脑、服务器)上轻松部署和运行各种大语言模型,无需依赖云端服务。如果显示 ollama server not responding -timed out ·······,进入ollama官网(一个小羊驼),下载ollama,不使用魔法下载会有些慢。搜索插件Code AI,我的插件里没有,搜索Pr

目录

ollama是什么?

ollama (读作欧拉马)是一个轻量级、开源的大语言模型(LLM)运行工具,让你能够在本地设备(如个人电脑、服务器)上轻松部署和运行各种大语言模型,无需依赖云端服务。

通过ollama下载大模型

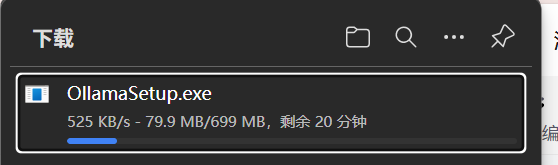

进入ollama官网(一个小羊驼),下载ollama,不使用魔法下载会有些慢。

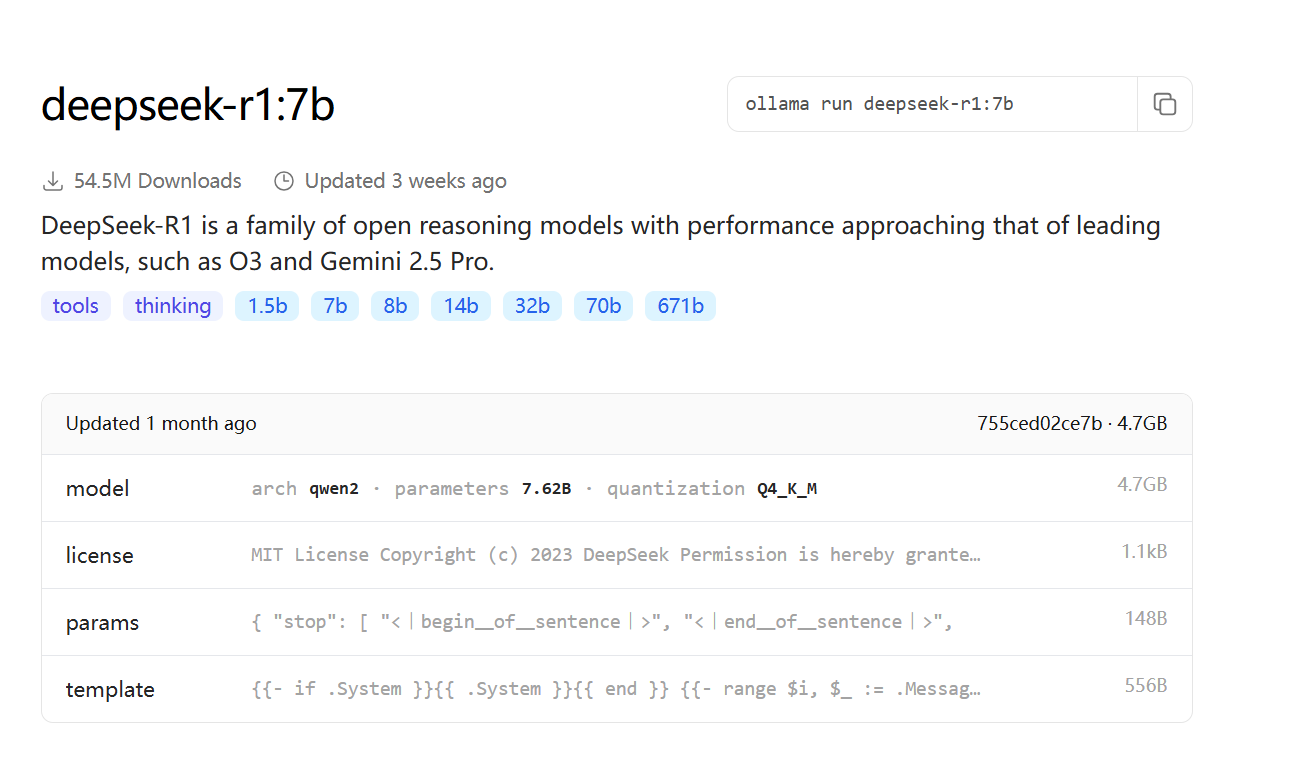

搜索要下载的大模型。

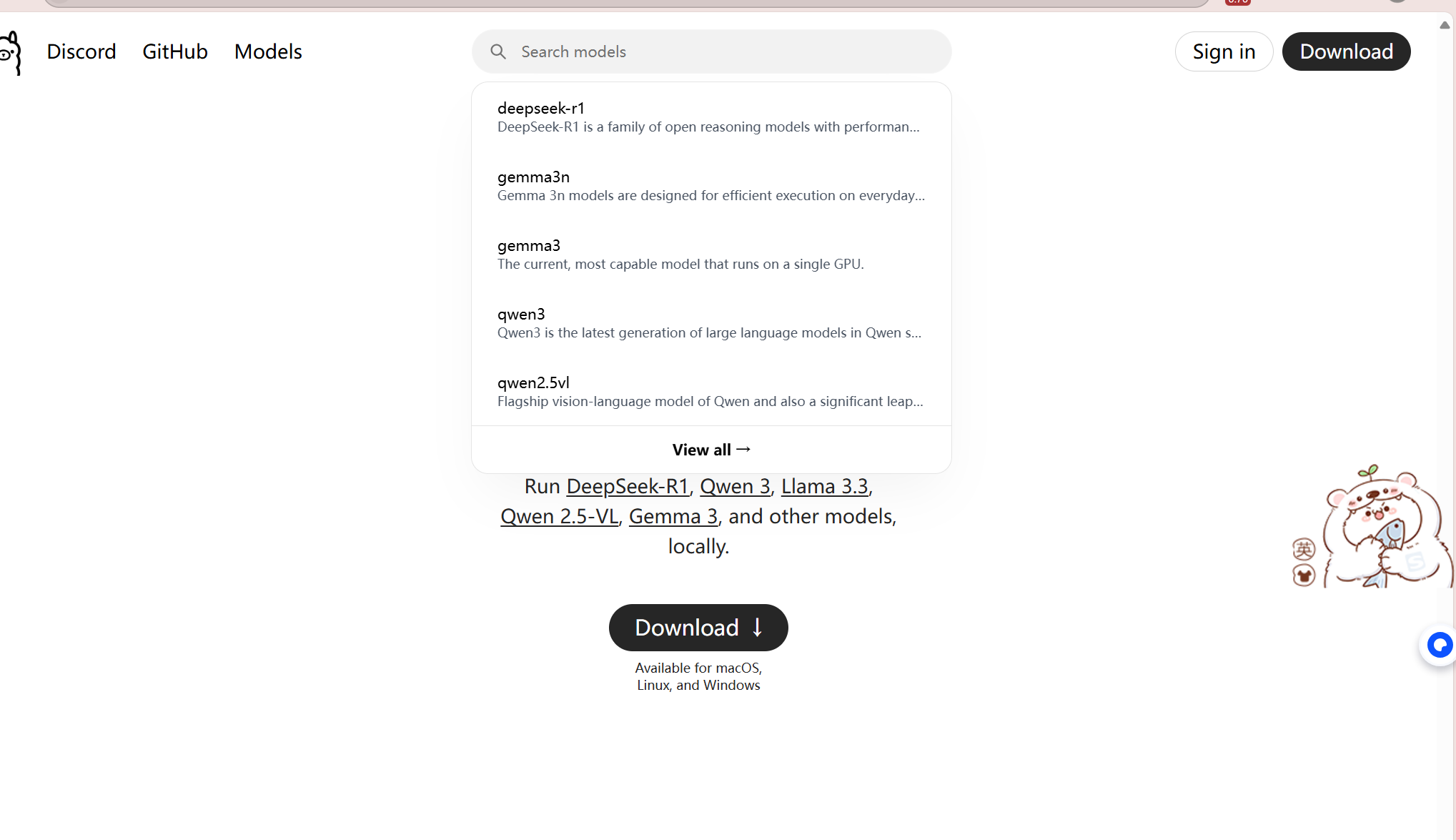

b代表参数量,1b就是1亿个参数量。参数量越高通常模型性能越好。

根据自己电脑的情况,通常做多下载7b就够用了。

复制命令 。

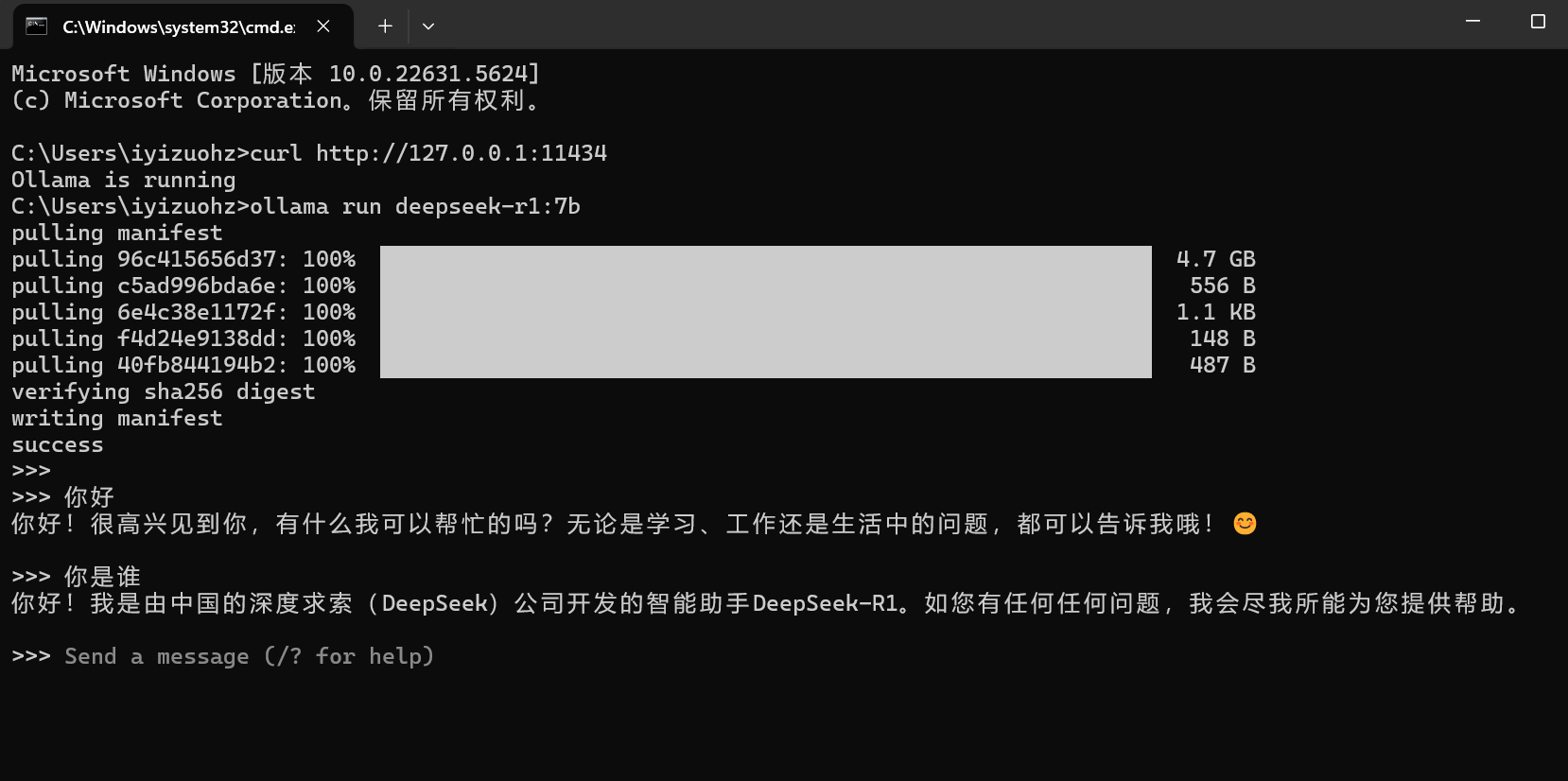

打开终端,直接输入复制的命令。

解决问题

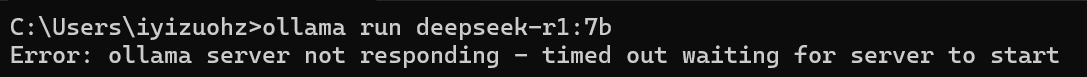

如果显示 ollama server not responding -timed out ·······,

终端运行指令检查ollama状态

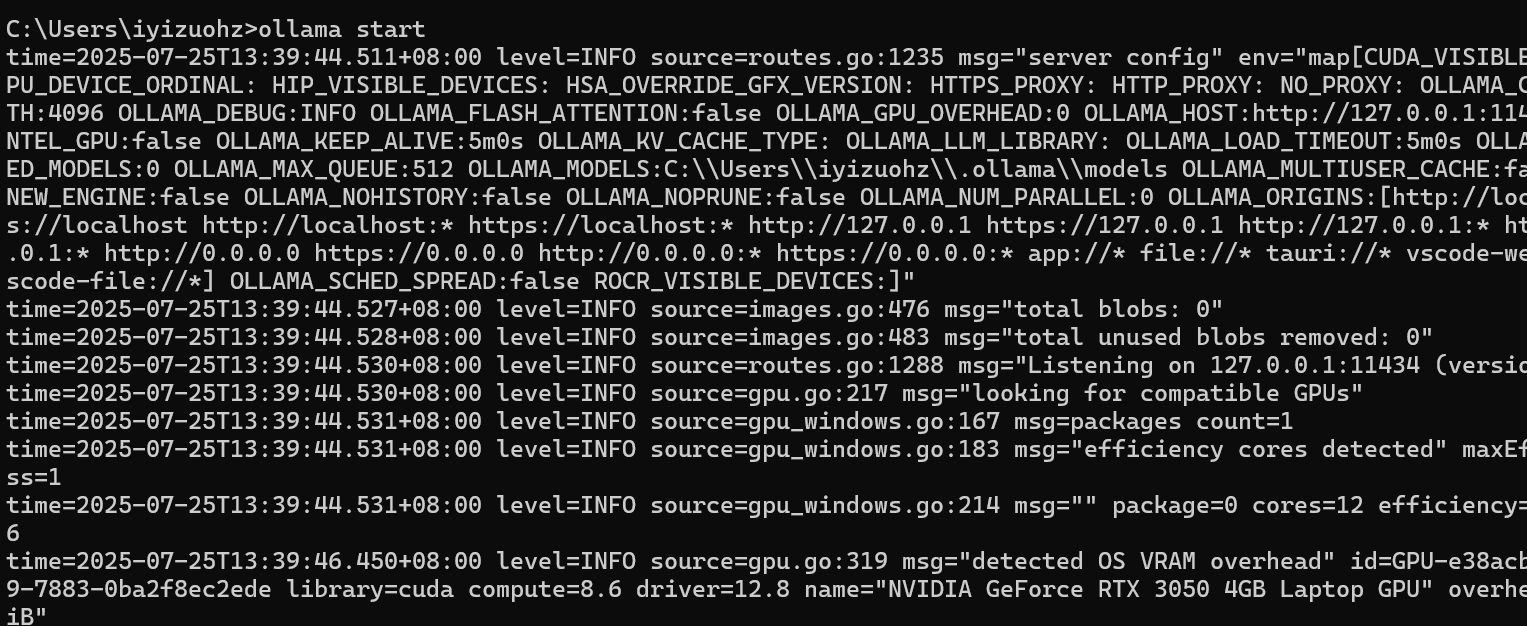

ollama status终端运行指令启动ollama

ollama start

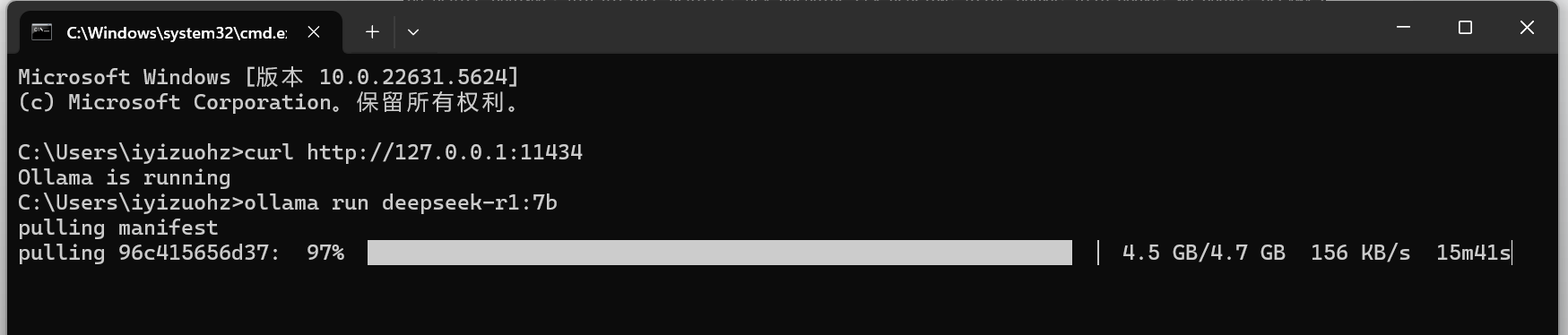

再另外开一个命令终端,重新 run 你的大模型,显示正在下载。

成功下载。

Pycharm中接入大模型

Pycharm必须是22年版本以上。

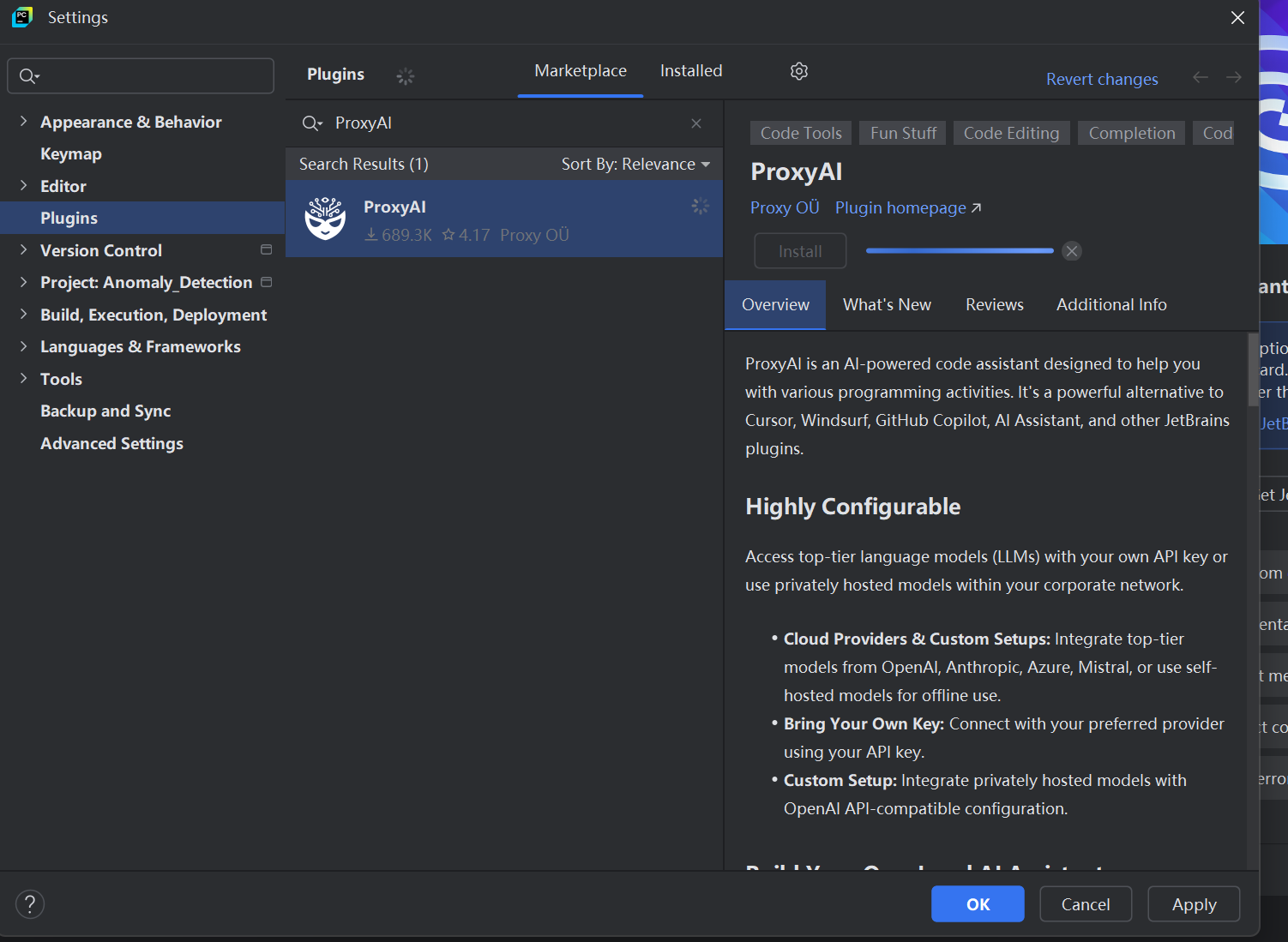

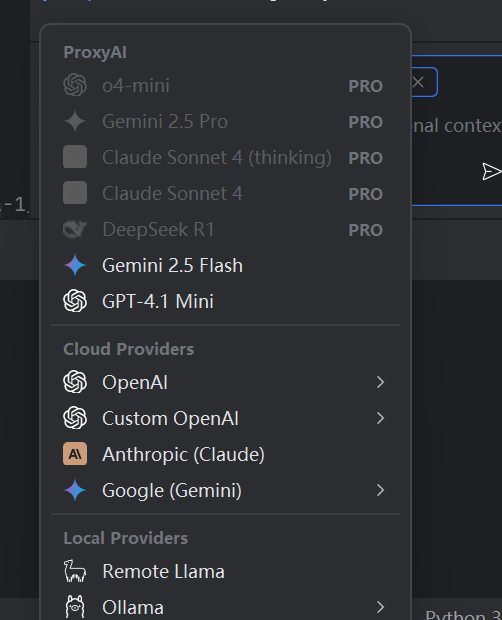

搜索插件Code AI,如果没有,因为现在改名了没有,搜索ProxyAI,点击安装。

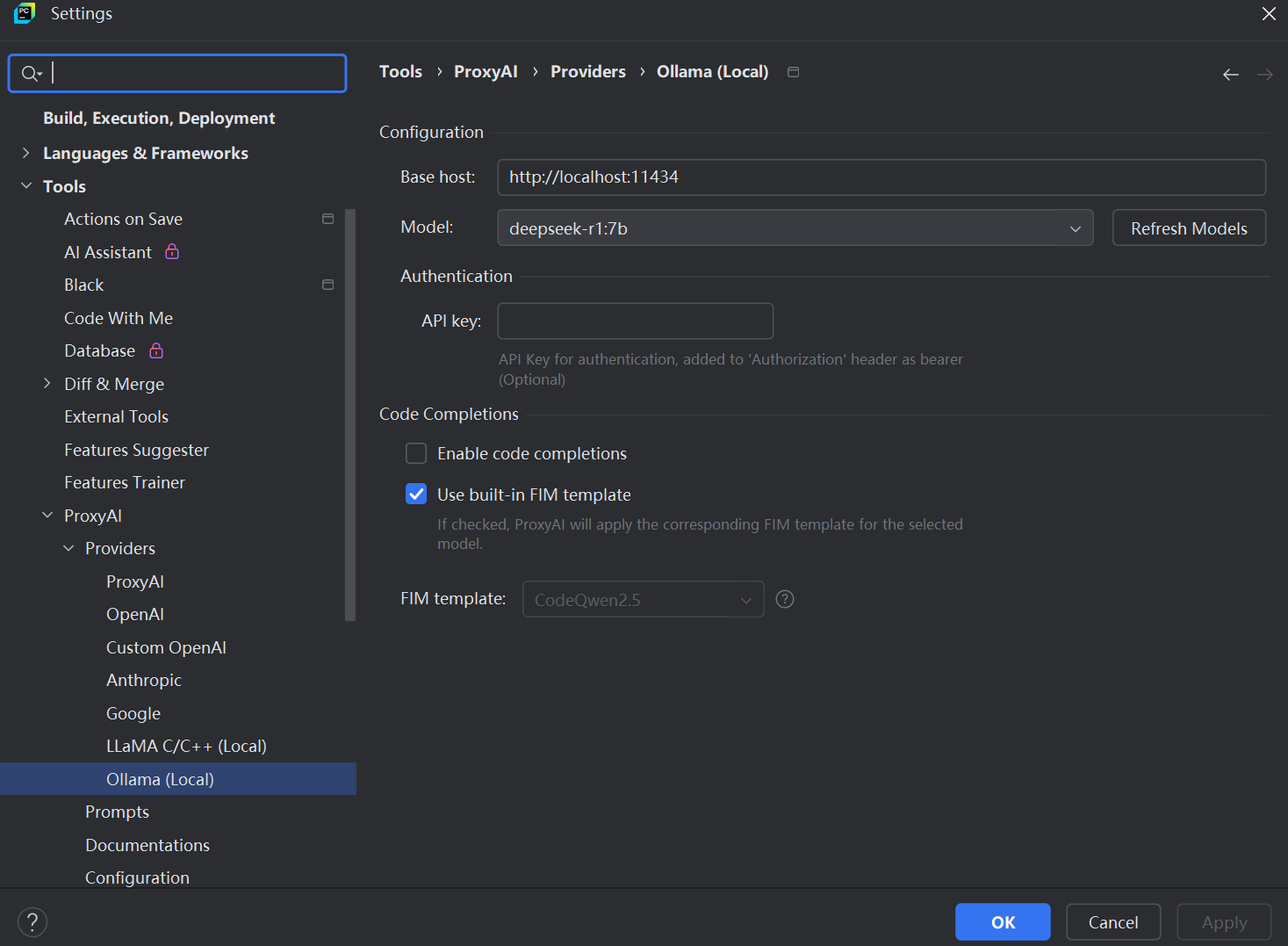

在Settings的tools中找到ProxyAI,找到Ollama,点击Refresh Models

点击Apply,点击OK。

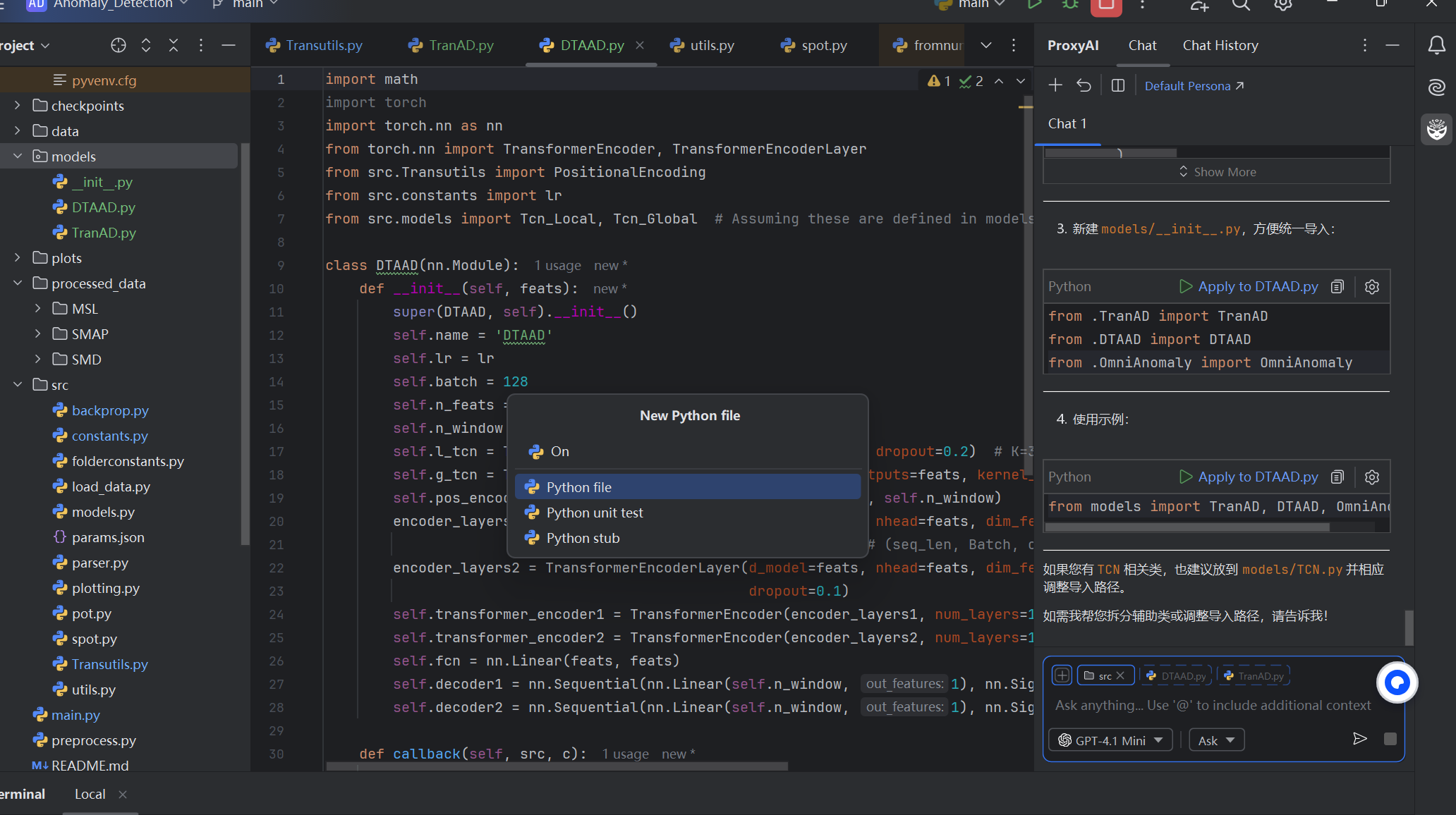

右边会显示该图标。

点击选择ollama,开启和大模型的对话。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)