Qt + RTSP协议实现多功能视频流播放器

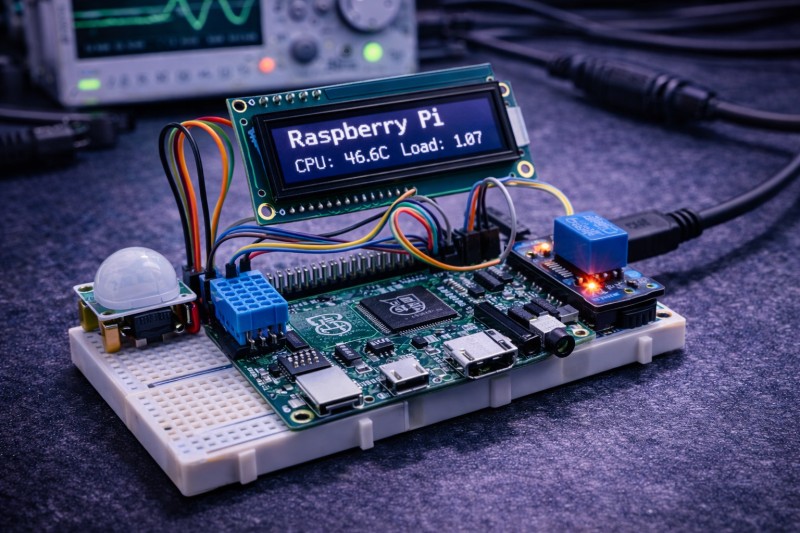

Qt是一个跨平台的C++应用程序框架,广泛应用于图形用户界面和实时应用开发。它提供了丰富的组件库,能够创建美观且功能强大的桌面、Web和嵌入式系统应用。Qt框架由多个模块组成,例如Qt Core模块提供了应用程序的基本功能;Qt GUI模块提供了窗口系统集成、事件处理、2D图形、基本成像、字体和文本等;Qt Multimedia模块则专为处理音频和视频数据而设计。通过这些模块的组合,Qt能够支持各

简介:本项目将介绍如何利用Qt框架与RTSP协议和FFmpeg库相结合,创建一个支持多通道视频流播放及截图功能的视频播放器。详细探讨RTSP基础,Qt的多媒体处理能力,FFmpeg库的应用,并涵盖设计三通道视频播放与截图功能的实现步骤。注意点包括FFmpeg库的安装、网络稳定性、服务器认证以及资源管理等,强调了这一技术在多个领域的应用潜力。

1. Qt框架介绍

Qt是一个跨平台的C++应用程序框架,广泛应用于图形用户界面和实时应用开发。它提供了丰富的组件库,能够创建美观且功能强大的桌面、Web和嵌入式系统应用。

1.1 Qt核心特性

Qt框架的核心特性包括信号与槽机制、元对象系统、丰富的控件以及高度模块化的设计。这些特性使得Qt不仅在GUI开发中表现优异,而且在非GUI程序设计,如命令行工具和服务器应用开发中也非常有用。

1.2 Qt模块概述

Qt框架由多个模块组成,例如Qt Core模块提供了应用程序的基本功能;Qt GUI模块提供了窗口系统集成、事件处理、2D图形、基本成像、字体和文本等;Qt Multimedia模块则专为处理音频和视频数据而设计。

通过这些模块的组合,Qt能够支持各种现代软件开发的需求,开发者可以根据需要选择合适的模块来构建应用程序。接下来的章节将深入介绍RTSP协议基础、Qt的多媒体处理能力以及FFmpeg库的集成,这些都是构建音视频应用不可或缺的技术。

2. RTSP协议基础

2.1 RTSP协议概述

2.1.1 RTSP协议的定义和作用

RTSP(Real Time Streaming Protocol)是一个网络控制协议,旨在控制流媒体服务器,它被设计为可以在一个可控的延迟范围内为客户端提供实时流数据。RTSP协议的提出,主要是为了解决流媒体在不同网络环境下的传输问题,提供一套控制媒体流的规则和方法。通过RTSP,客户端可以实现播放、暂停、快进、快退等操作,从而达到在客户端上播放流媒体的目的。

RTSP定义了一套控制消息,如PLAY、PAUSE等,这些消息帮助客户端对服务器上的媒体流进行控制。尽管RTSP本身不传输媒体数据,但是它和实时传输协议(RTP)经常被配合使用,RTP则负责媒体数据的实际传输。

2.1.2 RTSP与RTP、RTCP的关系

RTSP、RTP(Real-time Transport Protocol)和RTCP(Real-time Control Protocol)三者共同构成了流媒体传输的基础架构。RTSP在其中充当控制层的角色,它负责建立和控制媒体会话。RTP和RTCP则共同组成传输层,RTP主要负责传输媒体数据,而RTCP负责传输控制信息,如质量反馈和同步信息。RTSP通过控制RTP流来实现流的暂停、播放、快进等控制功能。

简单来说,RTSP作为信令协议,主要负责管理和控制流媒体会话,而RTP负责数据的实时传输,RTCP则用于传输质量监控等信息。

2.2 RTSP协议消息结构

2.2.1 请求和响应消息的格式

RTSP请求消息通常由请求行、请求头和消息体组成。请求行包含了方法名(如OPTIONS、DESCRIBE、SETUP、PLAY等)、URI和协议版本。请求头则由多个字段组成,用于提供额外的信息,例如接受的媒体类型、会话标识符、传输协议等。请求消息体则用于发送额外的数据,如SDP(Session Description Protocol)信息。

RTSP响应消息则包含状态行、响应头和可选的消息体。状态行包含了协议版本、状态码和状态码描述。响应头包含了服务器信息、会话标识符等。消息体部分,通常在成功响应时包含媒体初始化参数。

2.2.2 方法类型详解

RTSP协议定义了多种方法,用于不同的控制需求。以下是几种常见的RTSP方法:

- OPTIONS:该方法用于查询服务器支持的方法列表。

- DESCRIBE:该方法用于获取媒体对象的描述信息。

- SETUP:该方法用于建立一个到指定媒体流的传输连接。

- PLAY:该方法用于告诉服务器开始发送数据。

- PAUSE:该方法用于暂停当前的媒体流传输。

- TEARDOWN:该方法用于终止会话并释放资源。

这些方法通过在请求行中指定,以实现不同的控制功能,从而让客户端能够控制媒体流的播放和传输。

2.3 RTSP会话控制

2.3.1 会话建立与维持

会话的建立通常遵循以下步骤:

- 客户端发送OPTIONS请求来查询服务器支持的方法。

- 客户端发送DESCRIBE请求来获取媒体的描述信息。

- 客户端发送SETUP请求来准备一个媒体传输会话。

- 客户端发送PLAY请求来开始媒体流的传输。

维持会话的机制包括在SETUP请求中协商传输参数(如端口号、传输协议等),并在PLAY请求中指定会话标识符。会话通过持续传输RTP数据包来维持,通常由周期性地发送RTCP包来保证连接状态。

2.3.2 媒体传输控制

媒体传输控制包括了媒体流的开始、暂停、快进、快退以及停止传输等操作。例如,PLAY方法会开始媒体的传输,而PAUSE方法可以暂停媒体流的传输并保持当前位置。TEARDOWN方法则用于释放会话资源,停止媒体流的传输。

控制操作通常通过发送对应的方法请求来实现。客户端在发送请求时会通过请求头中的Range字段来指示播放的具体位置或时间范围。服务器则根据这些信息来调整媒体流的传输。

2.4 RTSP协议的端口和安全

RTSP协议默认使用554端口进行通信,使用TCP协议传输控制消息,使用UDP协议传输媒体数据。为了提高安全性,RTSP可以运行在TLS或SSL之上,即RTSPS。但是需要注意的是,RTSP并不直接提供媒体加密功能,媒体数据加密需要依赖于底层的RTP协议或其他安全解决方案。

2.5 RTSP协议实例分析

2.5.1 请求和响应消息的捕获

使用网络抓包工具如Wireshark可以捕获RTSP会话的整个交互过程。在Wireshark中,可以设置过滤条件来筛选出RTSP相关的流量,例如使用过滤器表达式 rtsp 来过滤出RTSP协议的数据包。

以下是一个简化的RTSP会话捕获的示例:

1. 客户端向服务器发送OPTIONS请求:

OPTIONS rtsp://serverIP:554/stream RTSP/1.0

CSeq: 1

2. 服务器响应客户端的OPTIONS请求:

RTSP/1.0 200 OK

CSeq: 1

Public: DESCRIBE, SETUP, TEARDOWN, PLAY, PAUSE

3. 客户端发送DESCRIBE请求以获取媒体流的描述:

DESCRIBE rtsp://serverIP:554/stream RTSP/1.0

Accept: application/sdp

CSeq: 2

4. 服务器返回媒体描述信息:

RTSP/1.0 200 OK

CSeq: 2

Content-Type: application/sdp

Content-Length: ...

v=0

o=Stream 1 0 0

s=Stream 1

...

2.5.2 媒体会话的控制

媒体会话控制的实例描述了媒体流的播放过程:

1. 客户端发送SETUP请求:

SETUP rtsp://serverIP:554/stream/trackID RTSP/1.0

Transport: RTP/AVP/TCP;unicast;interleaved=0-1

CSeq: 3

2. 服务器响应SETUP请求:

RTSP/1.0 200 OK

CSeq: 3

Session: 12345678

3. 客户端发起PLAY请求:

PLAY rtsp://serverIP:554/stream/trackID RTSP/1.0

Session: 12345678

Range: npt=0.000-

CSeq: 4

4. 服务器开始传输媒体数据,并返回响应:

RTSP/1.0 200 OK

CSeq: 4

Session: 12345678

Range: npt=0.000-57.324

通过这些示例,开发者可以更直观地理解RTSP会话中各个步骤和消息的含义,为在Qt中实现RTSP会话控制打下基础。

3. Qt多媒体处理能力

3.1 Qt Multimedia模块简介

3.1.1 Qt Multimedia模块的功能和组件

Qt Multimedia模块为开发者提供了一系列丰富的API,以处理音频和视频数据。通过使用Qt Multimedia,开发者可以轻松实现音视频的捕获、播放以及简单的编辑功能。模块内部集成了多种组件,如相机、音频录制、视频录制和播放等,使得跨平台的多媒体应用开发更为高效和便捷。

Qt Multimedia模块还支持实时流媒体协议,例如RTSP,允许开发者轻松集成媒体流到应用程序中。组件之间的协作使得开发者不需要深入了解底层协议,就可以实现较为复杂的多媒体应用场景。

3.1.2 音视频数据的捕获和播放

Qt Multimedia提供了一套标准的类和接口,以支持音视频数据的捕获和播放。例如,使用 QCamera 类可以控制连接到计算机的摄像头; QMediaRecorder 类能够捕获音频或视频内容; QMediaPlayer 类则负责音视频的播放功能。

开发者可以使用信号和槽机制,来处理媒体播放的各个事件,如播放结束、缓冲状态变化等。这样不仅使得播放控制更加直观,而且能够支持更为复杂的交互逻辑,如实现自定义的播放列表和播放状态管理。

3.2 Qt中的音视频处理技术

3.2.1 音频编解码技术

Qt Multimedia模块内部使用了FFmpeg这样的优秀第三方库来处理编解码工作。开发者可以通过 QAudioEncoderSettings 类设置音频编码参数,例如码率、采样率和编码格式等。在播放时,通过 QAudioDecoder 类来解码音频数据,为播放做好准备。

音频编解码技术的应用不仅涉及到音频数据的格式转换,还包括对不同音频格式的兼容性处理。Qt通过内置支持常见的音频格式如MP3、WAV等,大大简化了开发者的工作量。

3.2.2 视频编解码技术

视频编解码方面,Qt Multimedia同样提供了丰富的接口支持。例如 QMediaCaptureSession 类可以和 QVideoWidget 或 QGraphicsVideoItem 结合,进行视频捕获并显示在界面上。编解码视频时,可以利用 QVideoEncoderSettings 类设置视频编码参数。

视频编解码技术要求处理不同的视频编码格式和帧率,以保证在不同设备上的兼容性和流畅性。Qt通过内置多种视频解码器来满足这些需求,使得开发者只需很少的编码工作即可实现视频的播放和编辑功能。

3.3 Qt跨平台音视频支持

3.3.1 不同平台下的音视频处理差异

由于不同的操作系统对音视频的处理支持存在差异,Qt Multimedia在跨平台开发中扮演了极为重要的角色。开发者无需对不同平台的音视频API进行单独处理,Qt提供了一套统一的接口来屏蔽这些差异。例如,在Linux上,Qt Multimedia会使用GStreamer作为后端;而在Windows上,则使用DirectShow。

这种跨平台的兼容性大大减少了开发者的编码工作量,并确保了应用在不同平台上的功能一致性。开发者可以专注于应用层的逻辑实现,而不是底层的兼容性处理。

3.3.2 平台特定的处理优化

尽管Qt提供了一套跨平台的解决方案,但在某些特定情况下,开发者可能需要对平台特有的音视频处理做进一步的优化。Qt Multimedia模块允许开发者通过插件机制来扩展或替换默认的后端处理,以便更好地利用特定平台的性能优势。

例如,在处理高分辨率视频流时,不同平台的处理能力和性能瓶颈可能有所不同,这时可以为特定平台实现自定义的解码器来优化性能。通过这种方式,开发者能够根据不同的目标平台,提供更加流畅和高效的音视频处理体验。

// 示例代码:使用QMediaPlayer和QVideoWidget播放视频

QMediaPlayer *player = new QMediaPlayer;

QVideoWidget *videoWidget = new QVideoWidget;

// 设置视频输出

player->setVideoOutput(videoWidget);

// 设置媒体内容并开始播放

QMediaContent media(QUrl::fromLocalFile("video.mp4"));

player->setMedia(media);

player->play();

// 事件处理机制

connect(player, &QMediaPlayer::errorOccurred, [](QMediaPlayer::Error error) {

// 处理播放错误

});

在上述代码中,我们创建了一个 QMediaPlayer 对象和一个 QVideoWidget 对象来分别控制视频的播放和显示。通过 setVideoOutput 方法,我们将视频输出绑定到 QVideoWidget 上。接着,我们通过 setMedia 方法设置要播放的视频内容,并调用 play 方法开始播放。

该代码块展示了Qt Multimedia模块在音视频播放中的基本用法,并通过连接 QMediaPlayer 的 errorOccurred 信号来处理播放时可能出现的错误。这样的事件处理机制是Qt框架中常见的模式,它有助于开发者实现更为健壮的应用程序。

flowchart LR

A[开始播放] --> B[加载媒体内容]

B --> C{播放器状态}

C -->|空闲| D[准备播放]

D --> E[解码视频数据]

E --> F[显示视频帧]

C -->|错误| G[处理错误]

F --> H[结束播放]

通过mermaid格式的流程图,我们更加直观地展示了使用Qt Multimedia进行视频播放的处理流程。从开始播放到加载媒体内容,再到解码视频数据,最终显示视频帧,整个过程是有序且清晰的。这个流程图也可以作为开发者实现视频播放功能的参考。

4. FFmpeg库集成

4.1 FFmpeg概述

4.1.1 FFmpeg的功能和组件

FFmpeg是一个非常强大的多媒体框架,它包含了一系列非常有用的库和工具,用于处理音频和视频数据。FFmpeg可以执行解码、编码、转码、复用、解复用、流、过滤和播放几乎所有已知的音视频格式。

核心组件包括:

- libavcodec :包含各种编解码器;

- libavformat :处理多媒体文件格式的封装和解封装;

- libavutil :包含各种实用工具和函数;

- libavfilter :提供过滤音视频数据功能;

- libswscale :色彩格式转换;

- libswresample :音频重采样;

- FFmpeg 命令行工具:用于处理多媒体文件和流。

4.1.2 FFmpeg在多媒体处理中的地位

在多媒体处理领域,FFmpeg已经成为了一个不可或缺的工具。它被广泛应用于视频分享网站、流媒体服务、多媒体转换工具、播放器等多个方面。它的性能优秀、功能全面,且支持几乎所有主流操作系统,这些特点都保证了它在多媒体处理中的领导地位。

4.2 FFmpeg与Qt的集成

4.2.1 集成FFmpeg库的步骤

-

下载FFmpeg源码 :从官方网站或GitHub上下载最新版本的FFmpeg源码包。

-

编译FFmpeg库 :根据目标平台进行配置,编译生成libavformat、libavcodec等动态链接库。

-

配置Qt项目 :在Qt项目文件.pro中添加编译好的FFmpeg库文件路径以及库文件。

pro LIBS += -L/path/to/ffmpeg/lib -lavformat -lavcodec -lavutil -lswscale INCLUDEPATH += /path/to/ffmpeg/include

- 编写代码调用FFmpeg API :在Qt应用程序中调用FFmpeg库进行多媒体处理。

4.2.2 FFmpeg在Qt中的应用实例

以下是一个简单的Qt应用实例,展示如何集成FFmpeg进行音视频解码:

extern "C" {

#include <libavcodec/avcodec.h>

#include <libavformat/avformat.h>

}

// 初始化FFmpeg库

void initFFmpeg() {

av_register_all();

avcodec_register_all();

// 可以添加其他初始化代码

}

// 解码视频帧

void decodeVideoFrame(AVCodecContext* codecCtx, AVPacket* packet) {

// ... 解码逻辑

}

int main(int argc, char *argv[]) {

QApplication app(argc, argv);

initFFmpeg();

// ... 其他初始化代码

AVFormatContext* formatCtx = nullptr;

AVCodecContext* codecCtx = nullptr;

AVPacket packet;

AVFrame* frame = nullptr;

// 打开视频文件

if (avformat_open_input(&formatCtx, "input.mp4", nullptr, nullptr) != 0) {

// 错误处理

}

// 查找视频流信息

if (avformat_find_stream_info(formatCtx, nullptr) < 0) {

// 错误处理

}

// 查找视频流的解码器

int videoStreamIndex = av_find_best_stream(formatCtx, AVMEDIA_TYPE_VIDEO, -1, -1, nullptr, 0);

if (videoStreamIndex < 0) {

// 错误处理

}

AVCodec* codec = avcodec_find_decoder(formatCtx->streams[videoStreamIndex]->codecpar->codec_id);

if (!codec) {

// 错误处理

}

codecCtx = avcodec_alloc_context3(codec);

if (!codecCtx) {

// 错误处理

}

if (avcodec_parameters_to_context(codecCtx, formatCtx->streams[videoStreamIndex]->codecpar) < 0) {

// 错误处理

}

if (avcodec_open2(codecCtx, codec, nullptr) < 0) {

// 错误处理

}

// ... 读取和解码视频帧

// 清理资源

av_frame_free(&frame);

avcodec_close(codecCtx);

avformat_close_input(&formatCtx);

avformat_free_context(formatCtx);

return app.exec();

}

4.3 FFmpeg高级特性应用

4.3.1 流媒体处理和传输

FFmpeg不仅能够处理本地的音视频文件,还支持流媒体的处理和传输。这可以通过FFmpeg提供的网络库和协议实现。例如,通过RTMP协议进行实时视频流的传输。

4.3.2 高级编解码器和滤镜应用

FFmpeg支持许多高级编解码器,包括H.264、H.265、VP9等,以及专业的音频编解码器如AAC、AC-3等。此外,通过libavfilter库可以对音视频流进行各种复杂处理,例如视频滤镜、图像调整、字幕叠加等。以下是一个使用libavfilter添加水印的简单例子:

#include <libavfilter/avfilter.h>

int main(int argc, char *argv[]) {

// ... 初始化和解码逻辑

AVFrame* outFrame = av_frame_alloc();

AVFilterGraph* filterGraph = avfilter_graph_alloc();

AVFilterContext* buffersink_ctx = nullptr;

AVFilterContext* bufferSource_ctx = nullptr;

// 配置滤镜图

const char* filterDesc = "drawtext=fontfile=Arial.ttf:text='Watermark':x=10:y=H-th-10:fontsize=24:fontcolor=white@0.8";

// 这里省略了滤镜图创建和链接的步骤

// 将解码的帧发送给滤镜

av_buffersrc_add_frame_flags(bufferSource_ctx, frame, AV_BUFFERSRC_FLAG_KEEP_REF);

// 获取滤镜处理后的帧

int ret = av_buffersink_get_frame(buffersink_ctx, outFrame);

if (ret < 0) {

// 错误处理

}

// ... 使用处理后的帧

av_frame_free(&outFrame);

avfilter_graph_free(&filterGraph);

av_frame_free(&frame);

return 0;

}

以上就是关于FFmpeg在Qt框架中集成应用的详细介绍。通过FFmpeg的集成,开发者可以轻松在Qt应用程序中实现复杂的音视频处理功能。

5. 多通道视频播放实现

5.1 多通道视频播放需求分析

5.1.1 多通道播放的意义和应用场景

在许多监控系统和视频会议系统中,多通道视频播放成为了重要的功能需求。多通道播放意味着同时处理和展示多个视频源,这对于提高用户监控效率、增强视觉体验有着决定性的作用。比如,在城市监控中心,监控员可能需要同时查看数十甚至数百个监控点的视频画面,此时,多通道播放能够帮助他们及时发现异常情况,迅速做出反应。

5.1.2 同步机制和性能要求

由于每个通道的视频数据流可能来自不同的源,其传输延迟、编解码方式和分辨率都可能有所不同。这就对播放器的同步机制提出了较高的要求。播放器必须能够保证所有的视频流按照时间顺序同步播放,确保没有音视频不同步的情况发生。在性能上,要求播放器能够高效地处理多个视频流,占用系统资源少,对硬件的要求较低。

5.2 多通道播放器设计

5.2.1 播放器架构设计

多通道视频播放器的架构设计通常采用模块化方式,以便于不同功能的扩展和维护。一个基本的播放器架构包括视频解码模块、音视频同步模块、显示输出模块以及播放控制模块。通过解码模块将视频流数据解码为帧数据,音视频同步模块负责对解码后的音视频帧进行同步处理,显示输出模块将同步后的帧数据输出到显示设备,播放控制模块则提供了播放、暂停、停止等控制功能。

5.2.2 同步策略和缓冲机制

同步策略的制定是多通道播放器设计中的关键部分。常见的同步策略有时间戳同步、缓冲队列同步等。时间戳同步是根据视频帧的时间戳信息来调整播放节奏,保证视频流的时间连续性。缓冲机制则用于补偿不同通道间可能存在的延时差异,以及由于编解码造成的时延波动。缓冲队列需要适时地调整大小以适应不同的网络状况和系统负载。

5.3 多通道视频播放实践

5.3.1 实现多通道视频流同步播放

实现多通道视频流同步播放,首先需要确保各通道视频流的获取和解码是独立进行的。然后,需要对解码后的音视频数据进行时间戳对齐。具体操作时,可以使用一个缓冲区来缓存帧数据,并根据时间戳信息调整播放顺序。在Qt的实现中,可以利用QMediaPlaylist类来组织多个播放通道,并通过QTimer事件来控制缓冲区中数据的抽取顺序。

// 简化的伪代码示例,说明如何使用QMediaPlaylist同步播放多个视频流

QMediaPlaylist playlist;

playlist.addMedia(QMediaContent(QUrl::fromLocalFile("video1.mp4")));

playlist.addMedia(QMediaContent(QUrl::fromLocalFile("video2.mp4")));

// ... 添加更多视频流

QMediaPlayer player;

player.setPlaylist(&playlist);

player.play();

// 设置定时器,周期性地检查和调整视频帧的同步播放

QTimer timer;

QObject::connect(&timer, &QTimer::timeout, [&]() {

// 检查并同步每个视频流的播放位置

// 这里需要自己实现同步逻辑

});

timer.start(30); // 每30毫秒检查一次

5.3.2 性能优化和异常处理

性能优化通常从算法和资源利用两个维度进行。在算法上,可以对解码后的帧数据进行异步处理,减少主线程的负载。在资源利用上,需要合理地设置缓冲区大小和帧率,避免不必要的资源消耗。异常处理方面,则需要确保播放器在遇到网络异常、文件损坏等情况下能够恢复播放,或者提示用户进行处理。

以上是多通道视频播放实现的大致思路。实际上,每个环节都涉及到复杂的逻辑和细节,需要根据具体情况进行调整和优化。

简介:本项目将介绍如何利用Qt框架与RTSP协议和FFmpeg库相结合,创建一个支持多通道视频流播放及截图功能的视频播放器。详细探讨RTSP基础,Qt的多媒体处理能力,FFmpeg库的应用,并涵盖设计三通道视频播放与截图功能的实现步骤。注意点包括FFmpeg库的安装、网络稳定性、服务器认证以及资源管理等,强调了这一技术在多个领域的应用潜力。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)